🧠 Modele językowe przyszłości: Multimodalność, dłuższa pamięć i większa precyzja

🌍 Wprowadzenie

Modele językowe (LLM – Large Language Models) zrewolucjonizowały sposób, w jaki maszyny rozumieją i generują ludzką mowę oraz tekst. Od asystentów głosowych po narzędzia analizy językowej – ich zastosowanie jest wszechobecne. Jednak przyszłość modeli językowych AI to coś znacznie więcej niż tylko lepsze pisanie e-maili.

W tym artykule zagłębiamy się w trzy kluczowe kierunki rozwoju:

- Multimodalność – łączenie tekstu, obrazu, dźwięku i wideo w jednym systemie.

- Dłuższa pamięć – umożliwiająca rozumienie kontekstu z tysięcy wcześniejszych interakcji.

- Większa precyzja – poprzez lepsze uziemienie w faktach, kontekście i logice.

🧩 1. Multimodalność: Od słów do świata

🤖 Czym jest multimodalna AI?

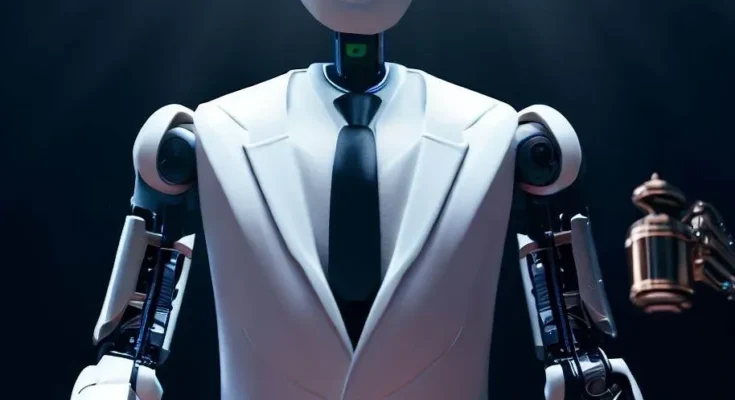

Multimodalna AI to zdolność modelu do jednoczesnego przetwarzania różnych form danych – tekstu, obrazu, dźwięku, kodu, a nawet wideo – i łączenia ich w jedną spójną reprezentację poznawczą.

Przykład:

ChatGPT-4o potrafi analizować zdjęcie, przeczytać dołączony tekst i odpowiedzieć na pytania dotyczące zawartości – wszystko w jednej sesji.

📷 Zastosowania multimodalnych modeli językowych

- Medycyna: analiza zdjęć rentgenowskich + opisów lekarskich.

- Edukacja: interpretacja wykresów, grafik, filmów edukacyjnych wraz z pytaniami testowymi.

- Przemysł kreatywny: generowanie opisów zdjęć, scenariuszy na podstawie obrazów.

🛠️ Przykłady systemów multimodalnych

| Model | Tryby wejściowe | Producent |

|---|---|---|

| GPT-4o | Tekst, obraz, dźwięk | OpenAI |

| Gemini 1.5 | Tekst, kod, wideo, obraz | Google DeepMind |

| Claude 3 Opus | Tekst, dokumenty PDF | Anthropic |

| Kosmos-1 | Tekst, obraz, mowa | Microsoft |

🧠 2. Dłuższa pamięć: Kontekst ma znaczenie

🔁 Limit kontekstu – problem współczesnych modeli

Modele językowe do niedawna mogły analizować ograniczoną ilość danych w jednej sesji (np. 2048 lub 8000 tokenów), co ograniczało ich zrozumienie długich dokumentów czy dialogów.

🔍 Ewolucja: Od krótkiej pamięci do długoterminowej pamięci roboczej

Nowoczesne modele jak GPT-4 Turbo czy Gemini 1.5 oferują kontekst sięgający nawet do 1 miliona tokenów, co pozwala:

- Czytać całe książki i raporty bez utraty spójności.

- Kontynuować rozmowy przez wiele dni/tygodni.

- Zachować „pamięć” o użytkowniku w interakcjach (z zachowaniem prywatności).

Przykład:

Model może podsumować książkę, zidentyfikować motywy literackie i porównać je z innymi dziełami, mając dostęp do pełnej treści, a nie tylko do jej fragmentu.

🧬 Implikacje dla zastosowań biznesowych

- Prawnicze analizy dokumentów.

- Analiza danych historycznych w finansach.

- Zarządzanie wiedzą w korporacjach.

🎯 3. Większa precyzja: Prawda, fakty i logika

❌ Problemy tzw. „halucynacji”

LLM-y są znane z generowania informacji, które „brzmią prawdziwie”, ale są nieprawdziwe. To ogranicza ich wykorzystanie w krytycznych dziedzinach (medycyna, prawo, finanse).

🧭 Rozwiązania dla większej dokładności

- Retrieval-Augmented Generation (RAG): model nie polega tylko na pamięci, ale szuka aktualnych danych w bazach wiedzy (np. wyszukiwanie w czasie rzeczywistym).

- Fine-tuning na specjalistycznych danych: dostosowanie modelu do konkretnego obszaru wiedzy.

- Uziemianie w faktach (truthful AI): weryfikacja odpowiedzi względem źródeł.

Przykład:

AI, która odpowiada na pytania z prawa karnego, może odwoływać się do konkretnych przepisów i wyroków, cytując źródła w czasie rzeczywistym.

💡 Przyszłe kierunki rozwoju LLM (2025 i dalej)

🧠 1. Modele z samoświadomością kontekstu

Systemy, które wiedzą, kiedy „nie wiedzą” i uczciwie odpowiadają: „Nie jestem pewien – poszukajmy razem”.

🔐 2. Bezpieczna pamięć długoterminowa

Użytkownik decyduje, co model „pamięta” między sesjami. Dane są lokalnie szyfrowane lub zdecentralizowane (Web3).

🌐 3. Integracja z agentami AI

LLM-y będą częścią większych systemów agentowych – zdolnych do działania w środowisku (np. zamawianie biletu, wysyłanie maili, planowanie podróży).

⚖️ 4. Rozwój modeli „transparentnych”

Powstają inicjatywy open-source, takie jak Mistral czy LLaMA 3, które mają pełną dokumentację i umożliwiają audyt działania modelu.

⚙️ Zastosowania przyszłościowe: Gdzie multimodalne, długopamięciowe i precyzyjne LLM-y będą niezbędne?

| Branża | Zastosowanie |

|---|---|

| Medycyna | Diagnozy na podstawie obrazu, historii choroby, analizy genetycznej |

| Edukacja | Personalizowane nauczanie z multimodalną interakcją |

| Inżynieria | Asystenci CAD + dokumentacja + testowanie symulacyjne |

| Finanse | Analiza trendów na podstawie danych, wiadomości i raportów |

| Media | Generowanie treści, dubbing, automatyczne tłumaczenia audiowizualne |

📈 Techniczne wyzwania przyszłości

- Koszt trenowania i inferencji: większy kontekst i multimodalność = więcej zasobów.

- Utrzymanie aktualności wiedzy: RAG i aktualizacje modeli stają się kluczowe.

- Zarządzanie pamięcią użytkownika: bezpieczeństwo i prywatność w długoterminowych interakcjach.

✅ Podsumowanie

Modele językowe AI przyszłości będą:

- Multimodalne – zrozumieją obraz, dźwięk i tekst jednocześnie.

- Długopamięciowe – utrzymają spójny kontekst na poziomie książek i rozmów wielotygodniowych.

- Precyzyjne – będą mniej podatne na halucynacje, bazując na faktach i źródłach.

Rozwój ten zmienia nie tylko technologię, ale całą strukturę interakcji człowiek–komputer. Przyszłość LLM to fundament nadchodzącej rewolucji w komunikacji, pracy, nauce i kulturze.

📚 Źródła i dalsza lektura

- OpenAI Technical Reports – GPT-4 Turbo, GPT-4o

- Google DeepMind – Gemini 1.5 Whitepaper

- Anthropic – Claude Model System Card

- Artykuł: “The Era of Multimodal AI” (Nature, 2024)

- “LLMs with Long Context Windows” – arXiv preprint